No version for distro humble. Known supported distros are highlighted in the buttons above.

No version for distro jazzy. Known supported distros are highlighted in the buttons above.

No version for distro kilted. Known supported distros are highlighted in the buttons above.

No version for distro rolling. Known supported distros are highlighted in the buttons above.

|

t-dt-2024-radar repositorydebug_map kalman_filter vision_interface cluster dynamic_cloud localization livox_interfaces livox_ros2_driver livox_sdk_vendor tdt_vision rosbag_player |

|

|

Repository Summary

| Description | 东北大学2024年雷达代码 |

| Checkout URI | https://github.com/t-dt-algorithm-2024/t-dt-2024-radar.git |

| VCS Type | git |

| VCS Version | main |

| Last Updated | 2024-11-12 |

| Dev Status | UNMAINTAINED |

| CI status | No Continuous Integration |

| Released | UNRELEASED |

| Tags | No category tags. |

| Contributing |

Help Wanted (0)

Good First Issues (0) Pull Requests to Review (0) |

Packages

| Name | Version |

|---|---|

| debug_map | 0.0.0 |

| kalman_filter | 0.0.0 |

| vision_interface | 0.0.0 |

| cluster | 0.0.0 |

| dynamic_cloud | 0.0.0 |

| localization | 0.0.0 |

| livox_interfaces | 0.0.1 |

| livox_ros2_driver | 0.0.1 |

| livox_sdk_vendor | 0.0.1 |

| tdt_vision | 0.0.0 |

| rosbag_player | 0.0.0 |

README

# 版本和发布记录

**v0.0.1beta**

- 初始化仓库,加入基础内容,初版README

**v1.0**

- 加入开源技术报告链接

**v1.1**

- TensorRT 10 API 支持

- Ubuntu 24.04 支持 (Jazzy分支)

- 删除rosbag_player包,改用 [rosbag2](https://github.com/ros2/rosbag2/tree/jazzy?tab=readme-ov-file#using-with-composition) 进程内通信 (Jazzy分支)

# 项目介绍

东北大学RM2024雷达技术报告 [https://bbs.robomaster.com/wiki/260375/27115](https://bbs.robomaster.com/wiki/260375/27115)

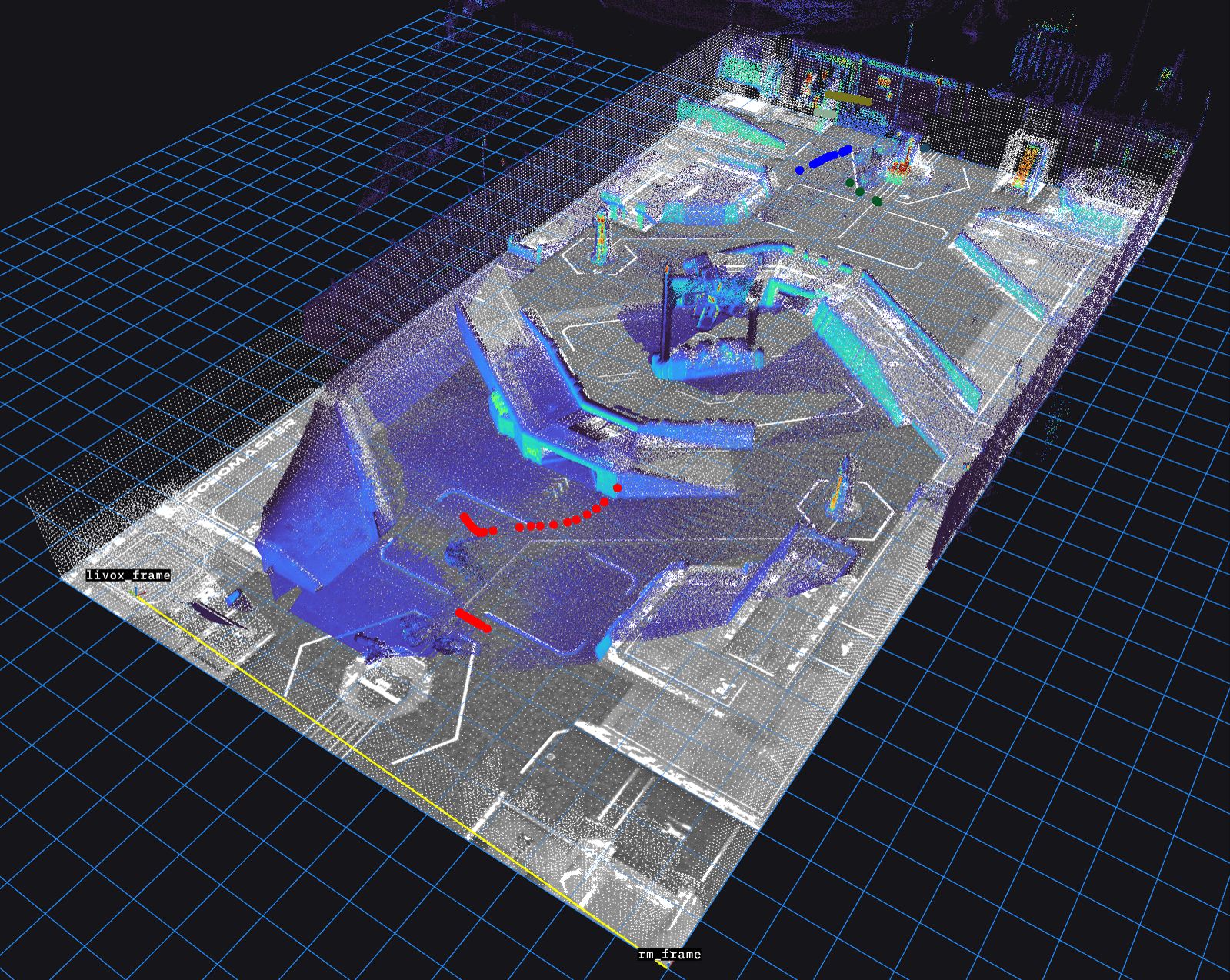

本项目通过激光雷达和单目相机的目标检测,进行传感器后融合,实现了传感器之间的完全解耦合,避免了联合标定带来的误差,同时开发难度不随传感器数量增加而增加。~~(如果和你关系好的队伍不幸被淘汰了,可以把相机/雷达直接借过来用。)~~

**如果你没有激光雷达,也可以直接使用本项目的单目相机方案 (在RM2023的0.6m误差规则下取得了最高91%的准确率,荣获2023年雷达MVP)**

图1:配准效果

CONTRIBUTING

No CONTRIBUTING.md found.

No version for distro noetic. Known supported distros are highlighted in the buttons above.

No version for distro galactic. Known supported distros are highlighted in the buttons above.

No version for distro iron. Known supported distros are highlighted in the buttons above.

No version for distro melodic. Known supported distros are highlighted in the buttons above.